Vor 250 Jahren wurde Albrecht Ludwig Berblinger alias „der Schneider von Ulm“ geboren, und die Stadt nahm sich das zum Anlass, dieses Jahr eine richtig grosse Sause zu schmeissen.

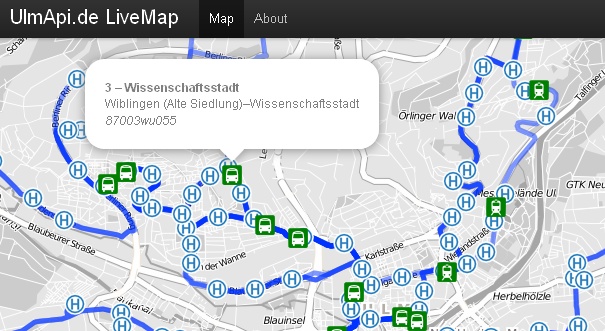

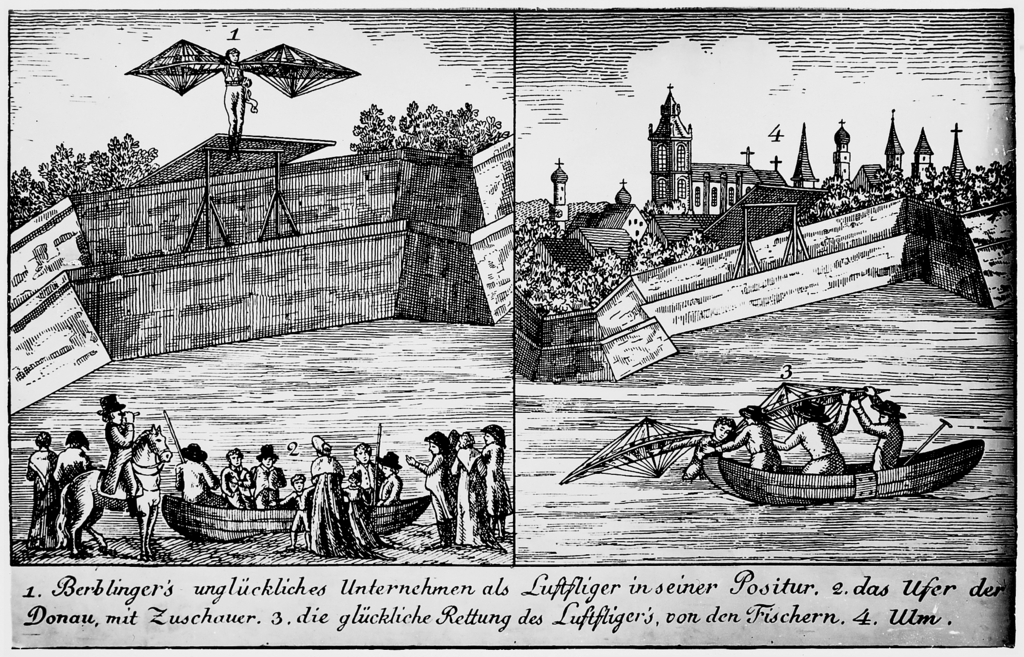

Berblinger, kurz zusammengefasst, baute Anfang des 19. Jahrhunderts einen ersten Haengegleiter, mit dem er Flugversuche unternahm – also Jahrzehnte vor Otto Lilienthal. In den Weinbergen am Michelsberg funktionierte das offenbar relativ gut, und irgendwann bekam er die Aufmerksamkeit vom damaligen Koenig von Württemberg, der seine Versuche daraufhin finanzierte.

Als der Koenig in der Stadt weilte, sollte Berblinger dem Finanzier seinen Apparat vorfuehren, aber diesmal vom Ufer der Donau aus. Berblinger kannte zwar den Begriff Thermik wohl nicht, war sich aber offenbar unsicher ob der „Fliegekraft“ ueber dem kalten Fluss und der Abwinde an der Stadtmauer. Ob am Ende wirklich ein Polizeibuettel den zoegernden Berblinger fuer das ungeduldige Publikum von der Adlerbastion schubste oder nicht – Berblinger stuerzte steil in die Donau, wurde sozial ausgestossen, starb verarmt.

Die Stadt nahm sich fuer das Berblingerjahr vieles vor, und manchem davon begegnete ich auch ein paar mal in der Planung. Ein Part – alles ausgedacht vor Covid-19 – ist der Test Test Contest: Menschen sollen Ideen fuer „Innovation“ einreichen und sollen diese dann in der letzten Auswahlrunde einer Jury vorstellen und diese ueberzeugen und dann winken Preisgelder.

Kommt einem bekannt vor, das Konzept, nicht? Ich war nicht so furchtbar angetan davon – meine Meinung zu Innovationswettbewerben mit Preisen und Jurys duerfte bekannt sein. Ein besonders kratzender Miss-Ton war fuer mich vor allem der krasse Widerspruch zwischen der Moral oder Pointe oder Botschaft der Berblinger-Story und dem Hoehle-der-Loewen-Konzept.

Auf der einen Seite steht ein Erfinder, der seiner Zeit voraus war und verlacht und verarmt starb – weil er nicht die Zeit und den Raum bekam, seine Forschung weiterzutreiben und ausreichend gut zu verstehen. Sondern es sollte einen, hm, Pitch zu vorgegebener Zeit und nach den Bedingungen des Geldgebers geben, und das ging dann in die Hose oder die Donau. Und auf der anderen Seite gibt es dann einen Contest, der genau das typische Geldgeber-Pitch-Format umsetzt.

Naja. Ich hatte damals dieses schiefe Bild erwaehnt, aber ich hatte offen gestanden auch ueberhaupt keine bessere Idee, wie man das anders machen koennte. Der Contest ist mittlerweile vorbei, und heute hatte ich mit einem der Beteiligten gequatscht, der auch ein wenig kritisch war. Danach diskutierte ich weiter mit @gruenzeug drueber, passenderweise als wir den zum Aktionsjahr aufgebauten Berblingerturm hochstiegen. Und vielleicht auch, weil @joliyea gerade ein „richtiges“ Hackathon-Handbuch aus Sicht von Digitalem Ehrenamt und Verwaltung schreibt, an dem ich gerade ein wenig mitschreibe, machte es auf einmal Klick. Was ich gerne mal stattdessen haette: Ein Pitch oder wie auch immer man das nennt, wo spannende Ansaetze vorgestellt werden. Und es am Ende aber nicht darum geht, die einzelnen Projekte mit Geld und Ruhm zu bewerfen. Sondern die Projektgruppen sollen umreissen, was es als lokale Stadt- (oder gar Land-!)gesellschaft an gemeinsamer, niedrigschwellig zugaenglicher Infrastruktur braeuchte, um diese Idee voranzutreiben. Und die fachkundige Jury kann sich gerne noch weitere Aspekte ausdenken, die es als oeffentlich zugaenglichen Service geben soll.

Ich bin mittlerweile lang genug in dem Geschaeft um zu wissen, dass 15.000 EUR an Einzelgruppen ausschuetten im Vergleich ultra einfach ist, und oeffentlich zugaengliche Infrastruktur bereitzustellen verdammt teuer und aufwaendig ist.

Aber manchmal braucht es halt einfach Ausdauer und langen Atem. Anstelle des metaphorischen ungeduldigen Polizeibuettels, der die Erfindung vor ihrer Zeit in die Donau stoesst. Und man stelle sich mal vor, was da alles bei rauskommen koennte. Wenn man nicht nur einzelne Projekte mit Geld bewirft (was abrechnungs- und steuertechnisch nicht selten eine Huerde und einen Ausschlussfaktor fuer sich darstellt) sondern wenn am Ende die gesamte Stadtgesellschaft mehr Zugang zu Dingen hat, mit denen sich Tolles, Spannendes und vielleicht auch einfach nur Schoenes schaffen laesst.

PS. Im Januar stiess ich auf diesen spannenden Bericht ueber die Donau-Ueberquerung per Heissluftballon durch Madame Bittorf. Die Madame – ueber die erstaunlich wenig bekannt zu sein scheint – schaffte im Berblinger-Donauabsturzjahr 1811, was der Schneider von Ulm nicht schaffte, naemlich einen Flug (okay, eine Fahrt) ueber die Donau, im Ballon.